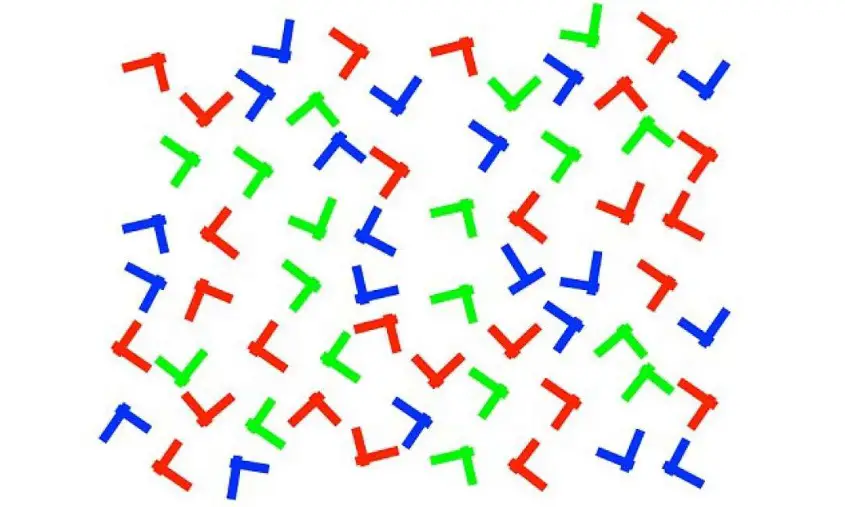

Ti piacciono i rompicapo, le illusioni ottiche e altre prove di abilità mentale? Questi tipi di giochi non sono solamente divertenti, ma ci aiutano anche a migliorare i riflessi del nostro cervello.

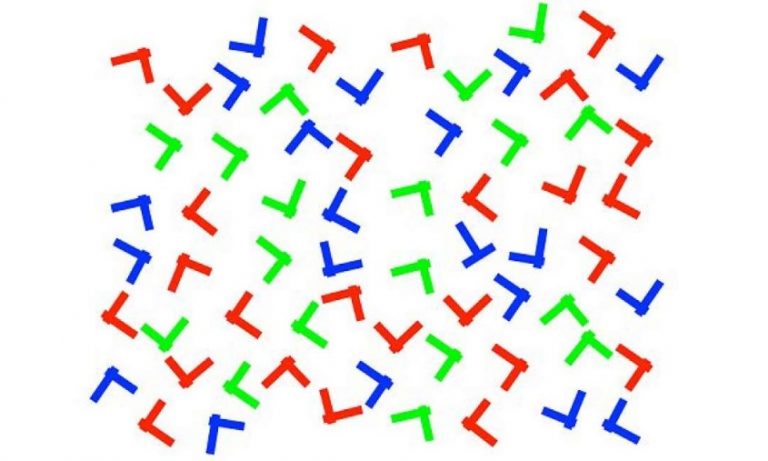

Il test che proponiamo di seguito è rimasto per molte persone un mistero irrisolto. Si tratta di scoprire dove si nasconde la lettera “T” tra le lettere “L”. L’hai già trovata o sei in difficoltà? Ti diamo un piccolo indizio, non si trova tra le lettere rosse.

Nonostante l’indizio non sei riuscito a trovare la lettera “T”? Forse questo potrebbe essere il motivo per cui non la trovi; secondo gli scienziati, sapere cosa non bisogna cercare diminuisce il tempo di reazione quando si tratta di trovare qualcosa nascosto.

In uno studio effettuato presso l’Università Johns Hopkins di Baltimora, negli Stati Uniti, i partecipanti sono stati istruiti per ignorare un colore specifico. Dopo aver effettuato diversi test, si è potuto notare che rispetto alle prove precedenti, i partecipanti sono stati in grado di trovare l’oggetto nascosto molto più facilmente e velocemente quando non gli è stato detto cosa dovevano ignorare.

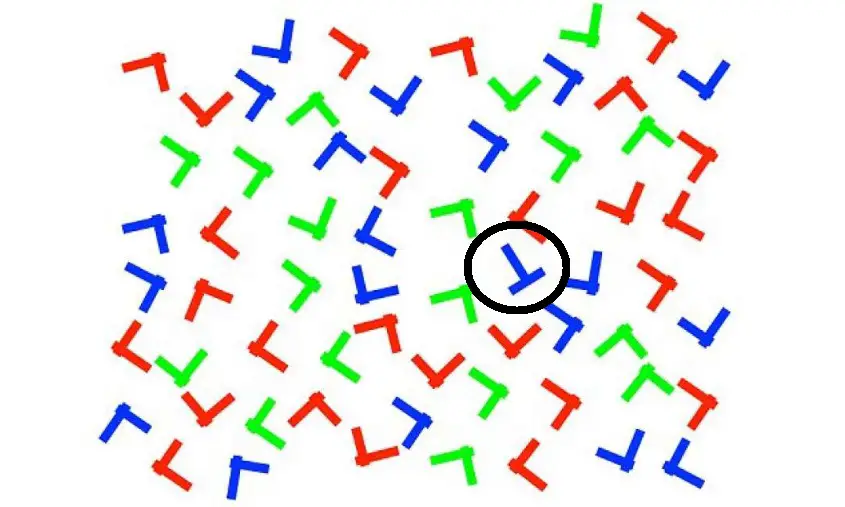

Ecco la soluzione:

Potrebbe interessarti: