Si parla sempre dei modelli di intelligenza artificiale — ChatGPT, gli assistenti, i generatori di immagini — ma quasi mai dei chip su cui girano. Eppure, secondo molti analisti, la vera partita dell’IA oggi si gioca lì: sul silicio e sull’energia. Cosa sono i “chip per l’intelligenza artificiale”, come funzionano e perché aziende come Google si stanno costruendo i propri.

La notizia: la corsa si sposta sui chip

Negli ultimi mesi diversi osservatori hanno notato un cambio di baricentro nel settore: dopo anni concentrati sui modelli, l’attenzione (e gli investimenti) si stanno spostando verso le infrastrutture — data center, catene di fornitura, energia e, soprattutto, semiconduttori. In questo quadro si inserisce il fatto che colossi come Google stiano lavorando, in collaborazione con produttori specializzati, allo sviluppo di nuovi chip dedicati all’IA, anche per ridurre la dipendenza da un numero ristretto di fornitori. È un segnale chiaro: chi controlla i chip, controlla il ritmo dell’intelligenza artificiale.

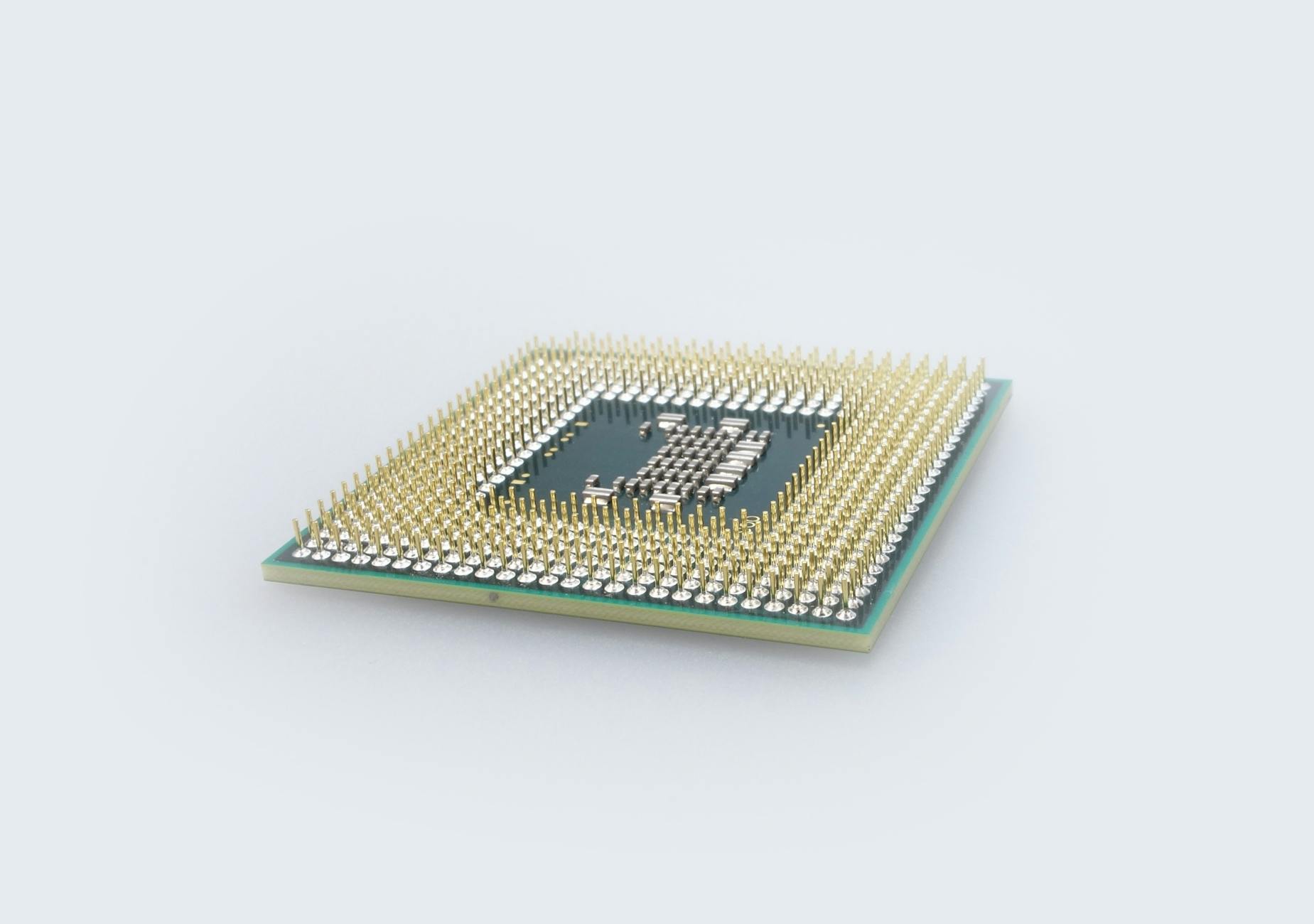

Cos’è un “chip per l’intelligenza artificiale”

Un chip per l’IA — più correttamente un “acceleratore” — è un processore progettato per fare bene una cosa sola: i calcoli matematici su cui si reggono le reti neurali. Detto in modo semplice, una rete neurale è una gigantesca catena di moltiplicazioni e somme tra numeri organizzati in tabelle (le “matrici”). Un processore tradizionale (la CPU del computer) è bravo a fare un po’ di tutto, ma poco efficiente in questo compito ripetuto miliardi di volte. Un acceleratore, invece, è costruito apposta per macinare quelle operazioni in parallelo, in quantità enormi, consumando meno energia per ciascuna.

Ne esistono di vari tipi: le GPU (nate per i videogiochi e poi diventate il cavallo di battaglia dell’IA), le TPU di Google, le NPU integrate negli smartphone e nei computer recenti, e i chip “su misura” che le grandi aziende si fanno progettare per i propri data center.

Addestramento e “inferenza”: due lavori diversi

Per capire perché servono chip dedicati bisogna distinguere due fasi nella vita di un modello di IA.

L’addestramento (training)

È la fase in cui il modello “impara”, analizzando enormi quantità di dati. Richiede potenza di calcolo colossale, settimane o mesi di lavoro su migliaia di chip, e costa moltissimo. È l’equivalente di costruire e istruire da zero un nuovo cervello.

L’inferenza (inference)

È la fase in cui il modello, già addestrato, viene usato: ogni volta che fai una domanda a un assistente, generi un’immagine o ottieni una traduzione, è inferenza. Ogni singola richiesta costa poco, ma moltiplicata per centinaia di milioni di utenti al giorno diventa, nel complesso, la voce di spesa più pesante. Per questo oggi tanti chip nuovi sono ottimizzati proprio per l’inferenza: l’obiettivo è rispondere in fretta spendendo poca energia.

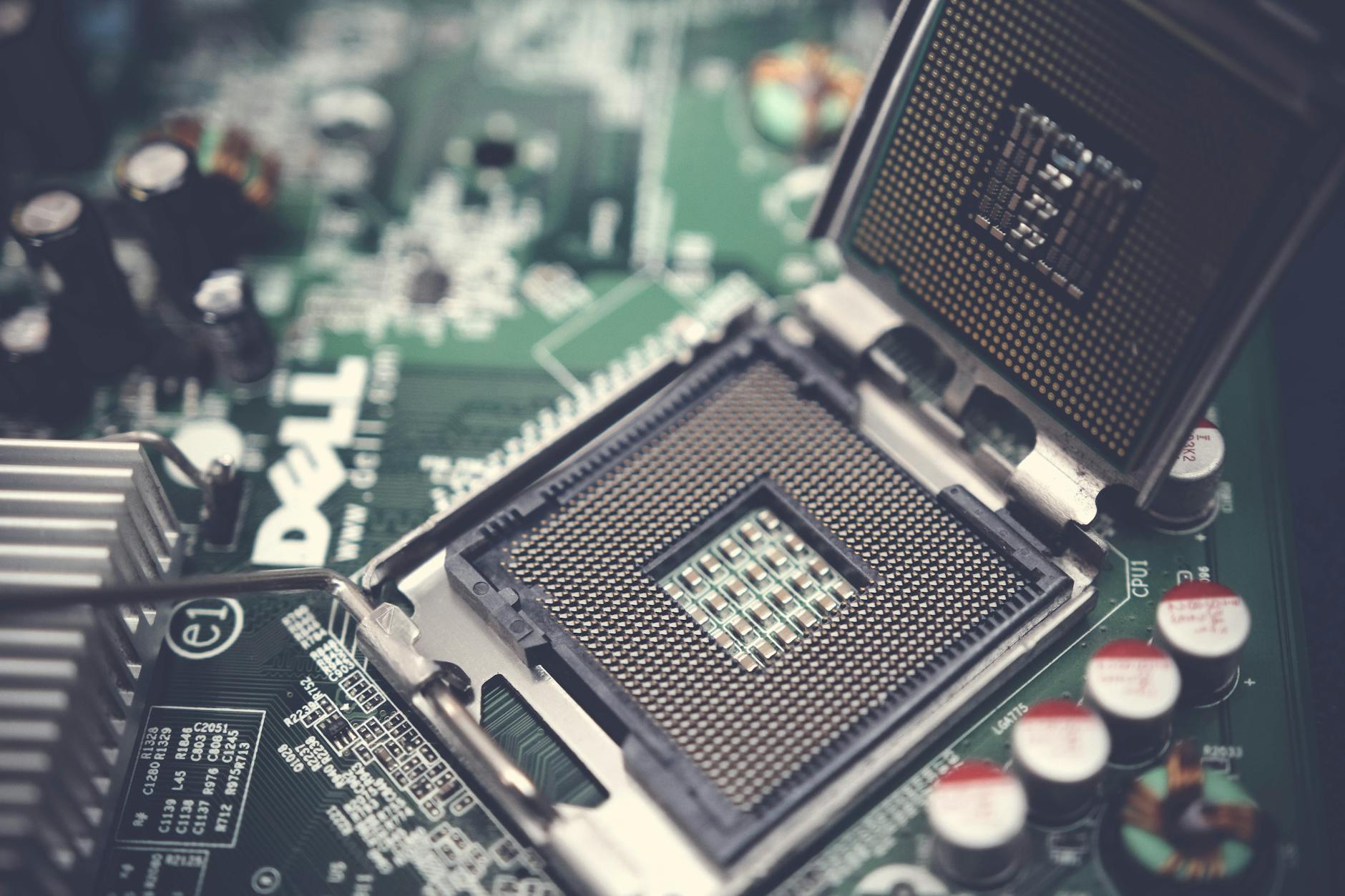

Perché le grandi aziende si fanno i chip in casa

Comprare chip da un fornitore esterno funziona, ma ha dei limiti: i prezzi sono alti, le forniture possono scarseggiare, e si dipende dalle scelte di pochi produttori. Progettare un acceleratore “su misura” permette di:

- ottimizzarlo per i propri modelli e i propri data center, guadagnando in efficienza;

- ridurre i costi sul lungo periodo, soprattutto per l’inferenza su larga scala;

- non restare ostaggio di un unico fornitore;

- avere un vantaggio competitivo difficile da copiare in fretta.

È il motivo per cui, oltre a Google, anche Amazon, Microsoft, Apple e altri hanno sviluppato chip proprietari, ciascuno con i suoi nomi e le sue specializzazioni.

Il problema (poco raccontato): l’energia

Dietro la frase “addestrare un modello” o “rispondere a un miliardo di richieste” c’è un consumo elettrico enorme. I data center dedicati all’IA richiedono tanta corrente — e tanta acqua per il raffreddamento — al punto che qualcuno ha descritto i nuovi chip come “elettricità travestita da silicio”. Migliorare l’efficienza energetica degli acceleratori non è quindi solo una questione di costi: è anche un tema ambientale e di sostenibilità delle reti elettriche, soprattutto se la domanda di IA continuerà a crescere come previsto. Una parte della ricerca sui chip punta esattamente a fare “più calcoli con meno watt”.

Cosa cambia per noi

Anche chi non si occupa di tecnologia subisce gli effetti di questa corsa:

- IA più veloce ed economica: chip più efficienti significano risposte più rapide e servizi che costano meno da offrire (e, in prospettiva, anche da usare).

- IA “sul dispositivo”: gli smartphone e i computer recenti hanno un piccolo acceleratore (NPU) che permette di far girare alcune funzioni di IA direttamente sul device, senza mandare i dati a un server remoto. Vantaggi: più privacy, funziona anche offline, meno ritardi.

- Geopolitica del silicio: la produzione di chip avanzati è concentrata in pochissimi luoghi del mondo, e questo ha conseguenze su economia, politica internazionale e sicurezza delle forniture. Non a caso l’Europa sta investendo in infrastrutture di calcolo: l’Italia, ad esempio, ha candidato Bologna come uno dei poli di una futura rete continentale dedicata all’IA.

In sintesi

I “chip per l’intelligenza artificiale” sono processori specializzati nel tipo di calcolo che fa funzionare le reti neurali. Servono sia per addestrare i modelli sia, sempre di più, per usarli ogni giorno in modo efficiente. La novità degli ultimi tempi è che le grandi aziende non vogliono più solo comprarli: vogliono progettarseli, per risparmiare, andare più veloci e non dipendere da nessuno. Sullo sfondo c’è il nodo dell’energia, che potrebbe diventare il vero limite di tutta la corsa. Per chi vuole capire le basi tecniche, è utile la voce “Rete neurale artificiale” su Wikipedia. E se ti piacciono i temi di frontiera spiegati in modo semplice, leggi anche il calcolo quantistico spiegato semplice.

Domande frequenti

Che differenza c’è tra una CPU e un chip per l’IA?

La CPU è un processore “generalista”, bravo a fare un po’ di tutto in sequenza. Un chip per l’IA è specializzato nel fare in parallelo miliardi di moltiplicazioni e somme, l’operazione di base delle reti neurali, in modo molto più veloce ed efficiente per quel compito specifico.

Cosa sono le GPU e perché si usano per l’intelligenza artificiale?

Le GPU sono nate per elaborare la grafica dei videogiochi, un lavoro fatto di tanti calcoli simili in parallelo. Si è scoperto che quella stessa struttura è perfetta anche per le reti neurali, ed è così che sono diventate il chip più usato per addestrare i modelli di IA.

Cosa significa “inferenza” nell’intelligenza artificiale?

È l’uso del modello già addestrato: ogni volta che poni una domanda a un assistente o generi un’immagine, stai facendo “inferenza”. Ogni richiesta costa poco, ma su scala globale è la parte più costosa, ed è per questo che molti chip nuovi sono pensati apposta per renderla efficiente.

Perché Google e altri si costruiscono i propri chip?

Per ottimizzarli sui propri modelli e data center, ridurre i costi a lungo termine, non dipendere da pochi fornitori esterni e avere un vantaggio competitivo. Lo fanno anche Amazon, Microsoft, Apple e altri grandi operatori.

Il mio smartphone ha un chip per l’IA?

Probabilmente sì, se è di modello recente: si chiama NPU (unità di elaborazione neurale) ed è quella che fa girare funzioni come il miglioramento delle foto, la trascrizione vocale o alcuni assistenti direttamente sul telefono, senza inviare i dati a un server.

L’intelligenza artificiale consuma davvero tanta energia?

Sì, soprattutto i grandi data center che addestrano e fanno funzionare i modelli: richiedono molta elettricità e acqua per il raffreddamento. È uno dei motivi per cui buona parte della ricerca sui chip punta a ottenere più capacità di calcolo con minori consumi.